用了快二十年的“便宜云”,可能要到头了

【编者按】当“创新”成为时代最响亮的号角,浙江正涌现一批不一样的企业家。他们不只“会做生意”,更是用科学家的钻劲、工程师的巧思,死磕核心技术。从一枚芯片、一个分子、一段代码,到一台智能设备、一种绿色能源……他们瞄准的,是真正能打、能赢未来的“硬实力”。潮新闻“潮·新质实验室”联合浙江大学国际联合商学院(ZIBS)、浙江大学国际校区隐形冠军国际研究中心推出财经观察栏目《周一晚8点》,化身探宝者,挖掘是谁在默默支撑中国制造的筋骨,解读他们突破的“独门绝技”,追问浙江的创新密码,未来的产业“风向标”又将指向何方。

一图导读 图片由AI生成

导读

每一瓦电的价格,正在重新定义云计算。

便宜云的时代用了近二十年,现在到头了。AI训练把GPU功耗推向千瓦级,把过去被规模摊薄的散热、电力和土建,重新拉回账本最显眼的位置。四大云厂商接连上调AI算力价格不是巧合,国家级专精特新“小巨人”企业曙光数创一季度782%的营收增长也不是异常。两条曲线指向同一个拐点:液冷不再是升级选项,而是入场门槛。云计算的下半场,胜负不在芯片,在每一瓦电。

用了快二十年的“便宜云”,到头了。

为什么这么说?首先我们来看一组数据:

2026年1月,亚马逊云服务(AWS)对大模型训练EC2实例提价15%,谷歌云紧随其后将AI基础设施部分服务直接翻倍。4月18日,阿里云算力卡涨价,百度智能云AI算力上调;不到一个月,从硅谷到国内,整个云行业在同一时间换挡。

2026年国内外云服务商AI算力涨价概览(部分) 图源:专栏基于公开资料整理制作

如今,算力不再是“想用多少就有多少”的便宜水电,而是要排队、议价、锁产能的稀缺品。延续二十年的“摩尔式降价”就此画上句号。而答案,要从一颗芯片的功耗说起。

被忽略的前提:散热近似免费

云计算在过去二十年里不断变便宜。

这个判断大体成立,但很少有人继续追问:它之所以能持续降价,隐含的前提是什么?

前提在于散热成本几乎不需要同步上涨。很长一段时间里,CPU功耗稳定在两三百瓦;标准42U机柜在热通道封闭后,功率密度通常也就到20kW左右,精密空调还能兜住。于是云厂商能把更低的电费与更高的机柜利用率部分让利给客户,价格战才打得起来。

这个前提在很长时间内都没有被打破——直到GPU进入数据中心主舞台。

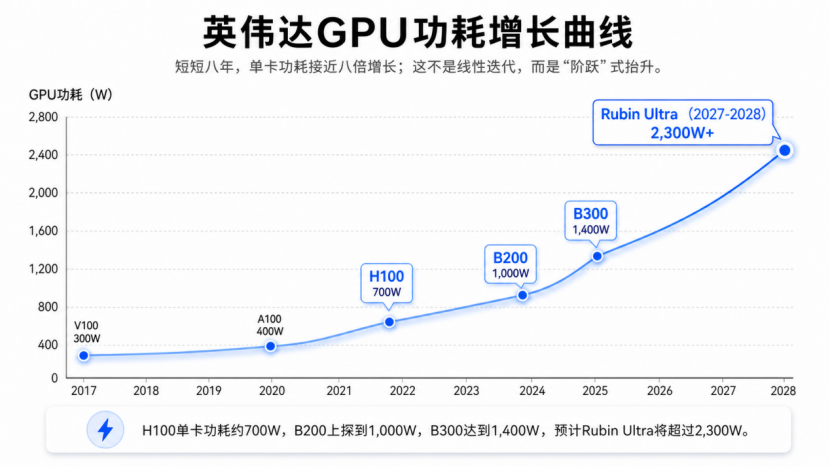

英伟达GPU功耗增长曲线图源:专栏基于公开资料整理制作

CPU时代功耗稳定在两三百瓦,整整二十年没有量级变化;而GPU把这个数字直接抬到了 700W,甚至是1000W以上,单卡功耗在五年里翻了近五倍。这不是线性迭代,而是“阶跃”式抬升。

当单台8卡GPU服务器功耗从5kW翻到10kW,当英伟达GB200 NVL72整机柜方案把功率密度推到120–140kW,“散热近似免费”的假设就近乎崩塌。风冷散热的有效上限约为20–30kW/机柜,超过这个阈值,热量在物理上就很难再依靠空气带走。

而散热扛不住的代价,会沿着供电链一层一层往上传,因此,能源问题并不是从“第 5 层”才突然出现的,而是从开始就被写进了成本结构。GPU功耗每增加100W,数据中心从板级供电、机柜散热到空调与变压器,都要被迫跟着升级。

AI基础设施五层架构图源:专栏基于公开资料整理制作

被改写的价值链:从拼装到施工

物理层面的“阶跃”,很快会以更直白的方式体现在账面上。

第一个后果是性能损耗。芯片温度一旦逼近安全阈值就会降频,这是硬约束,不靠调度策略就能绕过去。你花十几万买一张 H100,峰值算力写在规格表上,但在高温、高负载、长时间训练的现实里,跑出来的有效算力可能只剩七成。

散热难题的代价图源:专栏制作

过去这笔账没人较真。规格表上写的虽然是峰值算力,客户拿到却是打折货,但在GPU紧张到排队抢的年代,谁也不会为这缺少的几成和云厂商拗。云厂商也乐得维持这种“标称定价”的默契:硬件没用满的部分自己吃下,但销售口径上仍然是“标称算力出货”,毛利反而比实际交付更厚。

但这套默契如今正在两头同时崩。

第一头是大客户开始拥有议价权。OpenAI、Anthropic这种级别的买家签合约时要求按“持续算力”而不是“峰值算力”计费。云厂商再想维持折扣交付百分百收钱的模式,已经做不到。第二头是功率密度本身把折损面放大了。120kW机柜的降频幅度比20kW机柜严重得多,云厂商即使想用毛利吞下这部分支出,也越来越吞不下。

这种压力很快传导到电费。开源证券的测算显示,电力成本已占国内数据中心运营成本的56.7%。2024年中国数据中心总耗电 1,660亿kWh,预计2030年将超过4,000亿kWh。IEA数据同样指向同一趋势:2024 年全球数据中心耗电约415TWh,2030年预计945TWh——接近日本全年用电量。到这个量级,云厂商已经不可能继续把电费当成运营杂项消化掉了。

于是性能折损的压力开始向上游传导,整条价值链被迫反向重构。

过去二十年,数据中心的主旋律是“模块化、标准化、压价”。服务器、散热、配电、运维各自独立,标准件可替换,竞争就能把成本压下去。这个模式的隐含前提是:各环节之间不需要深度耦合。

如今液冷把这个前提打碎了。一个功率密度120kW的机柜,散热、配电、机柜结构与控制系统必须联动设计。这不是买几根水管装上就能跑,而是从土建阶段就要规划管路走向、承重、冷却液选型与冗余策略。这更像“工程耦合”,而不是“标准件拼装”。

国家级专精特新“小巨人”企业曙光数创的案例印证了这一点。据中国电子技术标准化研究院的数据显示,公司2024年液冷基础设施市场份额55.70%,连续四年第一。对比之下,服务器市场前五大厂商合计份额约50%。液冷赛道的集中度,已经超过了它本应替代的服务器赛道。背后原因并不复杂:服务器是标准件拼装,谁都能做;液冷仍停留在工程定制阶段,工程交付能力形成了更坚硬的壁垒,集中度也就不容易快速稀释。

经营数据则更直接:曙光数创2026年一季度营收同比增长782%。这不是渐进式增长,是一条折叠开的曲线。2025年营收8.82亿元,同比增长74%;冷板液冷在手订单同比增长2.4倍,非关联方在手订单6.48 亿元,覆盖61个项目。这些数字背后传递的是同一个信号:液冷不是“可选升级”,而是“必须采购”。客户在智算中心规划阶段就要锁定方案与供应商,否则机柜交付时,散热系统无法匹配,项目就会卡在最后一公里。

而当客户必须在土建阶段就锁定散热供应商时,这件事本身就说明:搭一个数据中心,已经从“组装”变成了“施工”。

电力即算力

散热和液冷是工程师的语言。但电费,是云厂商CFO的语言。

大多数人盯着大厂的财报看转折信号,但真正的信号在另一个地方:CFO们开始在公开场合主动谈PUE。

PUE(Power Usage Effectiveness)是数据中心总能耗与 IT 设备能耗的比值。比如,PUE等于1.5,意味着每给服务器供1度电,就要再花0.5度电用在散热、配电这些非计算环节上。过去这是机房工程师在内部周报里写的指标,CFO们关心的是营收、毛利等指标,没人会在分析师电话会上提它。但最近一两年,这件事变了。

毛利开始真实地被电力吞噬。电费被搬上财务台面,开始进入投资决策。

算力从技术问题转为商业问题图源:专栏制作

中国信通院数据显示,2024年数据中心总耗电1,660亿kWh,占全社会用电量1.68%,预计2030年将超过4,000亿kWh。到了那个量级,数据中心不再只是“用电大户”,而会成为影响电网结构与电价波动的关键变量。

芯片可以被代工产能、出口管制、产业政策左右;而电力是更底层的物理约束,不能进口,不能囤积,更不可能靠文件“变出来”。一个地区能承载多少算力,最终取决于电网容量与发电量,而不是芯片采购预算。

更直接的信号,藏在这些变化里:当一家云厂商在季度电话会上主动给出PUE目标;当一份选址报告把“绿电配额”写进第一优先级;当一支基金开始用“每兆瓦的算力密度”而非“GPU台数”来评估数据中心项目。这些变化才说明,行业已经重新定价成本与机会。

理解这一点,比讨论任何一家芯片公司的财报都重要。

所有文章未经授权禁止转载、摘编、复制或建立镜像,违规转载法律必究。

举报邮箱:1002263188@qq.com

上一篇:工大科雅等成立节能新材料公司

下一篇:全球首批船载养殖三文鱼首发上市